- 12 déc. 2024

Le workflow d'un projet de Data Science

- Agar Blohorn

- Data Science

- 0 comments

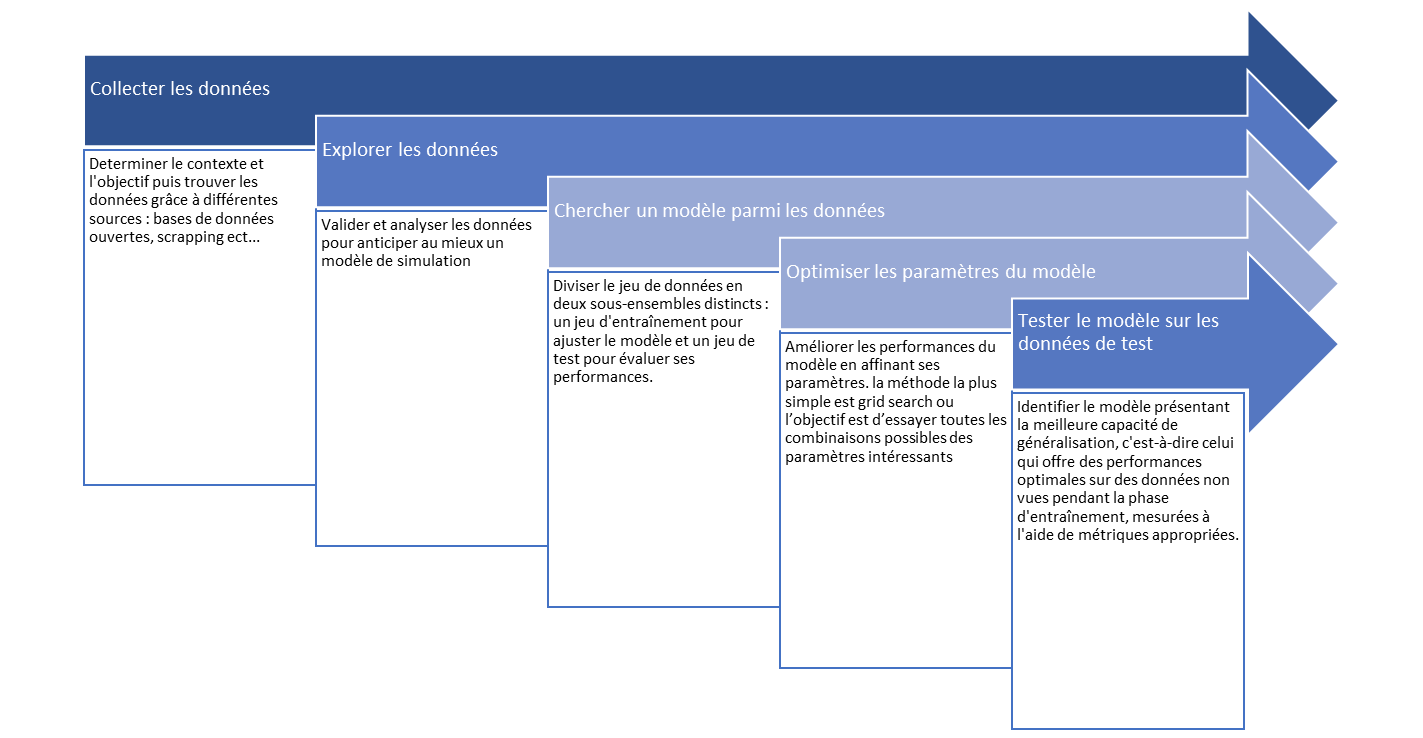

Dans ce nouvel article, nous parlerons des différentes étapes de construction d'un produit nécessitant des techniques d'analyse prédictive. Le Data Scientist conceptualise un nouveau produit selon son innovation et la faisabilité technologique de celui-ci. Imaginatif, il propose des idées qui répondent à un besoin, comme la construction d'un moteur de recommandation ou celle d'un appareil traducteur facilitant la communication entre deux personnes étrangères. De l'idée à la collecte des données jusqu'au déploiement du produit, le Data Scientist est confronté à plusieurs défis et difficultés. Je vous propose sans attendre d'en savoir plus sur les étapes essentielles d'un projet de Data Science.

Idée de produit

Tout nouveau projet débute à partir de nouvelles idées. Ces idées répondent à des besoins et demandent un travail en amont sur la formalisation claire de l'objectif de ce nouveau produit. Il y a plusieurs questions auxquelles il faut répondre avant d'entamer un travail approfondi sur la construction de ce nouveau produit :

Quel est l'objectif de ce produit ?

À quel public ce produit est-il adressé ?

Quelles données seront utiles pour répondre à cette problématique ?

Quelles seront les données explicatives et la ou les variables cibles, qui ne sont autres que les variables correspondant aux valeurs que l'on souhaite prédire ?

Comment va-t-on mesurer les performances de ce nouveau produit ?

Ces questions demandent du temps pour y répondre, mais surtout une communication claire avec les équipes métiers et marketing. Ce nouveau produit doit apporter de la valeur ajoutée pour être utile et commercialisable.

Collecte des données

Après avoir défini clairement les objectifs et les types de données nécessaires, il faut à présent les collecter. Il n'y a pas une seule façon de faire, et je dirais même que c'est au cas par cas selon les projets. Cependant, il faut répondre à certaines questions et respecter certaines conditions pour pouvoir collecter légalement et juridiquement les données et les utiliser. Déjà, est-ce que ces données sont disponibles ? En général, on cherche à acheter des données auprès d'organismes tiers, de fournisseurs ou bien à utiliser des données déjà présentes sur des plateformes "open data".

Un autre point à prendre en considération est la qualité des données récoltées. La quantité de données doit être suffisante pour entraîner le modèle à prédire efficacement, mais il faut aussi veiller à leur qualité pour éviter les problèmes de biais. Pour cela, il est indispensable de collecter des données qui représentent au mieux la réalité, donc des données riches et diversifiées.

Préparation des données

Une fois les données collectées, il faut les préparer. Les données ne sont jamais à 100 % prêtes à l'emploi : il y a souvent des données manquantes qu'il faut remplacer ou chercher dans d'autres sources, des données avec des formats erronés, des erreurs de frappe, etc. Cette étape est importante, car si elle n'est pas bien réalisée, les résultats qui suivent peuvent être faux. Ce nettoyage comprend généralement la détection des valeurs aberrantes, le remplissage des valeurs manquantes, et la mise à l'échelle de certaines variables pour harmoniser les unités. Cette étape est souvent la plus pénible pour un Data Scientist, car elle est difficilement automatisable et prend beaucoup de temps.

Exploration et analyse de données

L'exploration et l'analyse des données sont des étapes fondamentales. C'est le cœur du métier des Data Analysts.

Elles permettent de comprendre en détail les variables explicatives, la ou les variables cibles, ainsi que les corrélations entre elles. Certains jeux de données demandent d'extraire des sous-ensembles ou encore d'agréger les données pour en condenser et améliorer la compréhension. La visualisation à travers des graphiques comme les histogrammes ou les boîtes à moustaches permet de résumer les informations sur la répartition, la moyenne et la forme générale des données. On y décèle souvent des liens linéaires ou non linéaires et des tendances entre les variables, ce qui donne déjà une idée du type de modèle automatique à appliquer.

Modélisation des données

La partie souvent préférée des Data Scientists est l'étape de modélisation. Après avoir collecté, nettoyé, filtré et compris ses données, le Data Scientist cherche le meilleur modèle prédictif pour répondre à la problématique initiale. À partir de là, on peut enrichir le jeu de données avec la création de nouvelles variables explicatives, une tâche appelée "feature engineering". L'enrichissement d'un jeu de données demande une expertise dans le domaine d'application des données. Cela permet au modèle d'acquérir davantage d'informations et donc de prédire avec plus de précision. À cette étape, le Data Scientist doit encore se poser les bonnes questions, car qui dit modélisation dit mesure de performance, et il faut souvent choisir entre précision et interprétabilité. En effet, de plus en plus d'entreprises exigent que les résultats d'un modèle soient interprétables, alors que les modèles de deep learning par exemple sont souvent appelés "boîtes noires", car on ne sait pas toujours ce qui se passe dans le réseau pour obtenir tel ou tel résultat.

Dans la partie modélisation, je distingue deux tâches obligatoires :

La visualisation des performances d'un modèle

L'optimisation du modèle

Chaque étape est importante pour construire le meilleur modèle, la préparation des données, le nettoyage, la qualité des données ainsi que le choix du modèle.

Déploiement du modèle et mise en production

À cette étape, le Data Scientist est plutôt soulagé et déchargé des différentes difficultés rencontrées lors des étapes précédentes. Mais la vérité est que 80 % des modèles créés en Proof Of Concept ne sont pas industrialisables.

Un produit fini, pour être industrialisable, doit pouvoir supporter un volume de données plusieurs ordres de grandeur supérieur à celui utilisé pendant la phase de test. Le passage à l'échelle est donc la première contrainte qu'un modèle d'apprentissage doit supporter.

L'objectif du modèle est la prédiction, qui doit se faire le plus rapidement possible. Pour cela, lorsque de nouvelles données entrent dans l'algorithme final, il faut que celui-ci nettoie, transforme, enrichisse et génère des graphiques le plus rapidement possible. Cette étape impose une deuxième contrainte, qui est l'industrialisation de la chaîne de traitement.

L'industrialisation est une contrainte majeure du déploiement. Elle doit se réaliser sans erreur et demande une série de tests fonctionnant en continu. Heureusement, de nombreux outils existent aujourd'hui pour rendre cette étape plus facile et efficace.